Yan - stock.adobe.com

Deepfakes anhand visueller Hinweise und KI erkennen

Von KI erzeugte Deepfakes stellen ein ganz erhebliches Security-Risiko dar. Integrieren Sie diese Tipps zur Erkennung von Deepfakes in Schulungen zum Thema Sicherheitsbewusstsein.

Deepfakes – einst Stoff für Science-Fiction-Filme – sind heute so überzeugend, dass die besseren sogar versierte Endnutzer täuschen können.

Während einige KI-generierte Inhalte nützlich und völlig harmlos sein können, zielen Deepfakes – realistische, KI-generierte Bilder, Video- und Audioaufnahmen – oft darauf ab, zu täuschen und falsch zu informieren. Cyberkriminelle nutzen sie zunehmend, um Identitätsdiebstahl, Datendiebstahl und Betrug zu begehen.

In Unternehmen können Deepfakes zu schwerwiegenden Sicherheitsvorfällen und erheblichen finanziellen Verlusten führen. Bei einem dokumentierten Angriff beispielsweise nutzten Angreifer Deepfake-Technologie, um sich in einer Videokonferenz als CFO eines Unternehmens auszugeben und einen Finanzmitarbeiter davon zu überzeugen, ihnen 25 Millionen US-Dollar zu überweisen.

Viele Endanwender in Unternehmen sind sich nach wie vor nicht bewusst, dass solche Angriffe überhaupt möglich sind, weshalb die Aufklärung über Deepfakes eine wichtige Ergänzung zu Schulungen zum Sicherheitsbewusstsein darstellt. Dieser Artikel stellt Tipps und Tools vor, mit denen Mitarbeiter Deepfakes erkennen und ihre Unternehmen vor Cyberangriffen und Betrug schützen können.

7 Tipps zum Erkennen von Deepfakes

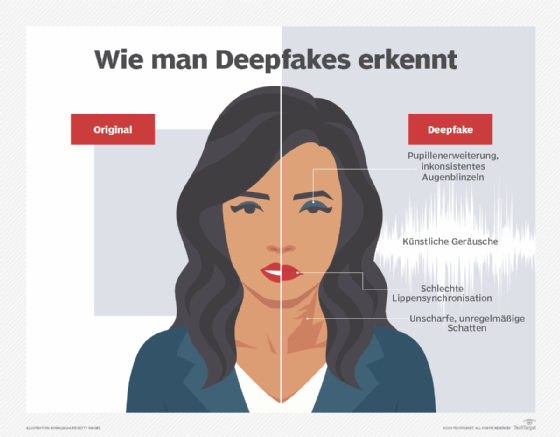

Benutzer sollten auf die folgenden Unvollkommenheiten, Unstimmigkeiten und Merkwürdigkeiten achten, die häufig in Deepfake-Bildern, -Videos und -Audioaufnahmen sowie -Streams auftreten.

1. Gesichts- und Körperbewegungen

Obwohl sich die Deepfake-Technologie rasant weiterentwickelt, gelingt es ihr oft nicht, Gesichtsausdrücke und Körperbewegungen zu erzeugen, die bei genauer Betrachtung menschlich und natürlich wirken.

Beim Betrachten von Bildern von Menschen mit unnatürlichen Eigenschaften löst das Gehirn eine negative emotionale Reaktion aus – bekannt als Uncanny Valley (Phänomen des unheimlichen Tals). Fordern Sie Ihre Mitarbeiter dazu auf, diesem Instinkt zu vertrauen, da er möglicherweise der einzige Hinweis darauf ist, dass sie Deepfake-Inhalte betrachten.

2. Lippensynchronisation erkennen

Lippenbewegungen, die nicht mit der entsprechenden Stimme übereinstimmen, können aufgrund von veränderten Audioaufnahmen und Synchronisationsproblemen auf Deepfake-Aktivitäten hindeuten.

3. Inkonsistentes - oder ausbleibendes - Augenblinzeln

Derzeit hat KI Schwierigkeiten, das natürliche Blinzeln der Augen zu simulieren. Infolgedessen erzeugen Deepfake-Algorithmen oft inkonsistente Blinzelmuster oder unterdrücken das Blinzeln der Augen vollständig.

4. Unregelmäßige Reflexionen oder Schattenbildung

Deepfake-Algorithmen versagen oft dabei, Schatten und Reflexionen realistisch darzustellen, die im Kontext des Bildes Sinn ergeben. Schauen Sie sich Reflexionen und Schatten auf umgebenden Oberflächen, im Hintergrund und sogar in den Augen der Personen genau an, um zu sehen, ob sie natürlich wirken oder Ihnen verdächtig vorkommen.

5. Pupillenerweiterung

KI verändert in der Regel nicht den Durchmesser der Pupillen der Personen, was manchmal dazu führen kann, dass die Augen unnatürlich wirken. Dies ist besonders deutlich zu erkennen, wenn die Augen der Person auf Objekte fokussiert sind, die entweder nah oder weit entfernt sind, oder wenn sie sich an mehrere Lichtquellen anpassen müssen. Wenn Sie Personen beobachten, deren Pupillen sich nicht auf natürliche Weise erweitern, ist dies ein Hinweis darauf, dass es sich bei dem Video um ein Deepfake handelt.

6. Unstimmigkeiten zwischen Haut und Gesichtsmerkmalen

Die Personen in Deepfakes weisen oft eine seltsam gleichmäßige Haut auf, der die natürlichen Unterschiede in Textur und Färbung fehlen, die durch Falten, Sommersprossen, Sonnenflecken, Muttermale, Narben und Schatten entstehen. Außerdem wirken die Gesichtszüge möglicherweise nicht harmonisch – vielleicht sehen die Augen der Person viel jünger aus als ihre Haut und Haare oder umgekehrt.

7. Auffälligkeiten im Audiobereich

Stimmen, die unnatürlich flach, repetitiv oder verzerrt klingen, sollten Verdacht erregen. Ebenso könnten Stimmen, die in Echtzeitgesprächen nicht auf Tonfalländerungen reagieren, Deepfakes sein. Einige Deepfakes weisen auch offensichtlich künstliche Hintergrundgeräusche auf.

Wie man mit KI gefälschte Inhalte erkennt

Da die Technologien zur Erstellung von Deepfakes immer besser werden, wird es immer schwieriger, festzustellen, ob Inhalte verändert wurden. Aber künstliche Intelligenz kann auch eingesetzt werden, um künstlich erzeugte Deepfakes zu erkennen. Und die gute Nachricht ist, dass sich die Technologien zur Erkennung von Deepfakes mit der Weiterentwicklung der Deepfake-Erstellung auch weiterentwickeln werden (siehe auch Wie sich Deepfakes mit Technologie erkennen lassen).

Heute gibt es mehrere Erkennungstools, die große Mengen an gefälschten Bildern, Videos und Audiodaten verarbeiten. Durch maschinelles Lernen und Deep Learning werden die Daten analysiert, um unnatürliche Muster zu erkennen, die darauf hindeuten, dass die Inhalte künstlich erstellt wurden.

Im Folgenden werden zwei weitere Möglichkeiten vorgestellt, wie KI zur automatischen Erkennung von Fälschungen eingesetzt werden kann:

1. Analyse der Quelle. Die Identifizierung der Quelle einer Multimediadatei kann ein Indiz dafür sein, dass sie verändert wurde. Die Herausforderung besteht darin, dass die Analyse der Dateiquelle eine gewaltige Aufgabe ist, wenn manuelle Methoden verwendet werden. Deepfake-Erkennungsalgorithmen können viel gründlicher und schneller reagieren, da sie die Metadaten der Datei analysieren, um sicherzustellen, dass ein Video völlig unverändert und authentisch ist.

2. Überprüfung der Videokonsistenz im Hintergrund. Früher war es einfach, einen Deepfake anhand seines Hintergrunds zu erkennen. Aber heute sind die KI-Tools so weit fortgeschritten, dass sie zunehmend in der Lage sind, Hintergründe so zu verändern, dass sie komplex und authentisch aussehen. Deepfake-Detektoren können veränderte Hintergründe aufspüren, indem sie hochgranulare Überprüfungen an mehreren Punkten durchführen, um Änderungen zu erkennen, die das menschliche Auge nicht wahrnimmt.