phonlamaiphoto - stock.adobe.com

Wie trifft künstliche Intelligenz eigentlich Entscheidungen?

Es existiert kaum noch ein Anwendungsbereich, in dem nicht in irgendeiner Form KI-Systeme zum Einsatz kommen. Aber wie gelangen neuronale Netze eigentlich zu den Entscheidungen?

Ob bei der Interpretation des Kundenverhaltens, medizinischer Diagnostik oder Bilderkennung: der Einsatz von Systemen mit künstlicher Intelligenz (KI) ist in vielen Anwendungsbereichen längst Alltag. Und viele der Fortschritte im Bereich KI beruhen auf dem Einsatz von neuronalen Netzen. Bislang ist häufig aber nicht wirklich erkennbar, wie diese Systeme zu ihren jeweiligen Entscheidungen gelangen.

Forschende des Fraunhofer Heinrich-Hertz-Instituts HHI und der Technischen Universität Berlin haben nun eine Technik entwickelt, die erkennen kann, anhand welcher Kriterien die Lösungen mit künstlicher Intelligenz schlussendlich ihre Entscheidungen fällen. Die Methode mit der Bezeichnung „Spectral Relevance Analysis (SpRAy)“ basiert auf der Technik Layer-Wise Relevance Propagation (LRP). Spectral Relevance Analysis (SpRAy) kann ein breites Spektrum erlernten Entscheidungsverhaltens identifizieren und quantifizieren. Damit sei es möglich, auch in riesigen Datensätzen unerwünschte Entscheidungen zu erkennen.

So identifiziert die Technik die einzelnen Input-Elemente, die von dem System für eine Vorhersage genutzt wurden. Im Bereich Diagnostik wird das Beispiel eines Gewebebildes genannt. Dabei würde der Einfluss jedes einzelnen Pixels auf das Klassifikationsergebnis quantifiziert. Die Vorhersage, wie „krebsartig“ oder „nicht krebsartig“ das Gewebebild ist, werde so mit der Angabe der Basis für diese Klassifikation ergänzt.

„Nicht nur das Ergebnis soll korrekt sein, sondern auch der Lösungsweg. Bislang wurden KI-Systeme als Black Box angewendet. Man hat darauf vertraut, dass sie das richtige tun. Mit unserer Open-Source-Software, die die Layer-Wise Relevance Propagation einsetzt, ist es uns gelungen, die Lösungsfindung von KI-Systemen nachvollziehbar zu machen“, so Dr. Wojciech Samek, Leiter der Forschungsgruppe „Machine Learning“ am Fraunhofer HHI.

KI-Systeme finden nicht immer sinnvolle Lösungswege

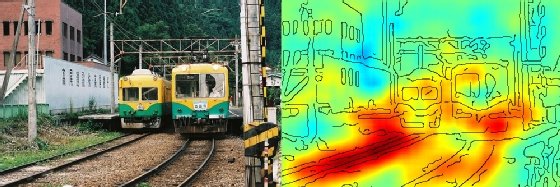

Bei der Bilderkennung entschlüsselt das Verfahren beispielsweise die Funktionsweise von neuronalen Netzen und erkennt, anhand welcher Merkmale ein Pferd als Pferd identifiziert wird und beispielsweise nicht als Esel. So würde die LRP-Technologie an jedem Knotenpunkt des Netzes erkennen, wie Informationen durch das Netz fließen. Dies erlaube es sogar, sehr tiefe neuronale Netze zu untersuchen.

„Mit LRP visualisieren und interpretieren wir neuronale Netze und andere Machine-Learning-Modelle. Mit LRP messen wir den Einfluss jeder Eingangsvariablen für die Gesamtvorhersage und zerlegen die Entscheidungen des Klassifizierers“, so Dr. Klaus-Robert Müller, Professor für Maschinelles Lernen an der TU Berlin.

Tests des Forscherteams haben ergeben, dass KI-Systeme nicht immer sinnvolle Lösungswege finden. So klassifizierte beispielsweise ein renommiertes KI-System Bilder anhand des Kontextes. Es wurden Fotos der Kategorie Schiff zugeordnet, wenn viel Wasser im Bild zu sehen war. Die eigentliche Aufgabe Schiffe zu erkennen, wurde hingegen nicht gelöst, auch wenn die Mehrzahl der Bilder korrekt identifiziert wurde. „Zahlreiche KI-Algorithmen wenden unsichere Strategien an und kommen zu wenig sinnvollen Lösungen“, resümiert Samek das Ergebnis der Untersuchungen.

Derzeit würden die Forscherteams des Fraunhofer HHI und der TU Berlin an neuen Algorithmen arbeiten. Dies, um weitere Fragestellungen zu untersuchen und so KI-Systeme sicherer zu gestalten.