peshkov - stock.adobe.com

Generative KI: eine neue Ära der Mensch-Maschine-Interaktion

Generative KI ist seit ChatGPT in aller Munde und spielt auch im Geschäftsumfeld eine Rolle. Dabei bewegt sich die Technologie im Spannungsfeld zwischen Hype und Verantwortung.

Unternehmen binden Generative KI zunehmend in umfassende KI-Strategien ein. Damit das gelingt, ist es zunächst erforderlich, Vertrauen in die Technologie aufzubauen.

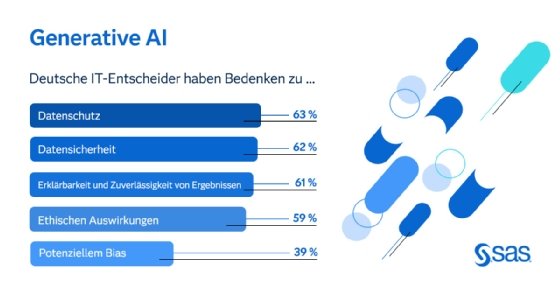

Laut einer globalen Studie des Daten- und KI-Experten SAS hegen deutsche IT-Entscheider vor allem Bedenken im Hinblick auf Datenschutz und Datensicherheit (63 Prozent beziehungsweise 62 Prozent). Darüber hinaus äußern jeweils rund 60 Prozent der Befragten Vorbehalte, was die Erklärbarkeit und Zuverlässigkeit von Ergebnissen beziehungsweise deren ethische Auswirkungen angeht.

Vielseitige Einsatzmöglichkeiten

Immerhin geben fast alle Befragten (96 Prozent) an, dass ihr Unternehmen bereits generative KI einsetzt. Und es gibt vielseitige Anwendungsoptionen für diese Technologie:

Large Language Models: Im Beschwerdemanagement lassen sich auf der Basis von Tausenden Text- oder Audiobeispielen hochpersonalisierte Antwortschreiben verfassen – automatisiert, effizient und relevant.

Synthetic Data: Statistisch kongruente Daten, die sich wie echte Daten verhalten, so in der Realität aber nicht existieren, schaffen Mehrwert für Bereiche, in denen entweder nicht genügend beziehungsweise keine Daten vorliegen, oder wo es um sensible Daten geht (zum Beispiel im Gesundheitswesen).

Digital Twins: ermöglichen Simulationen und What if-Szenarien in einer virtuellen Umgebung, die in einer Real-World-Umgebung schwierig wären, beispielsweise bei komplexen Systemen wie Lieferketten oder Fertigungsumgebungen.

Experten schätzen, dass generative KI in den kommenden Jahren ein echter Business-Faktor wird: Acumen Research and Consulting ging Ende 2023 davon aus, dass der globale Markt bis 2032 einen Umfang von 208,8 Milliarden US-Dollar erreichen wird. Die Boston Consulting Group wiederum schätzt den adressierbaren Markt für generative KI auf 60 Milliarden US-Dollar bereits im Jahr 2025.

Generative KI im Geschäftsalltag

Unterschiedlichste Branchen können bereits von generativer KI profitieren.

Banken und andere Finanzdienstleistungsunternehmen sind beispielsweise in der Lage, anhand von mit generativer KI erstellten Simulationsdaten für Stresstests und Szenario-Analysen finanzielle Risiken vorherzusagen und Verluste zu verhindern. Simulierte Daten können auch die Modellierung von seltenen Ereignissen verbessern, wie zum Beispiel Betrugsfälle.

Versicherer können synthetische Daten nutzen, die historischen Informationen zu Policen und Schadenersatzanträgen ähneln, um Preisgestaltungsmodelle zu trainieren und zu testen, ohne vertrauliche Kundendaten zu verwenden. Synthetische Daten helfen auch bei der Bewertung statistisch unwahrscheinlicher Ereignisse wie Erdbeben oder Überflutungen.

In der klinischen Forschung lassen sich Informationen aus komplexen Daten extrahieren, um – im Sinne des Datenschutzes – synthetische Daten und digitale Zwillinge als Ersatz für persönliche Daten von Probanden zu erstellen. Auf diese Weise lässt sich die Entwicklung neuer Medikamente beschleunigen, auch wenn keine realen Patientendaten vorliegen oder deren Nutzung aus Datenschutzgründen ausscheidet.

In der Fertigung unterstützt generative KI die Optimierung von Betriebsabläufen, Wartungen, Lieferketten oder Energieverbrauch, was zu geringeren Kosten, einer höheren Produktivität und mehr Nachhaltigkeit führt.

Innovation versus Risiken

Einerseits birgt generative KI also ein beträchtliches Potenzial für den Business-Einsatz. Andererseits bestehen – ebenso wie bei KI allgemein – auch erhebliche Bedenken gegenüber der Technologie, insbesondere wenn es um die Verwendung sensibler Daten geht.

Beim Einsatz von generativer KI sollte die Frage Was können wir tun? grundsätzlich immer gefolgt sein von Was sollten wir tun?, um einen verantwortungsvollen Umgang mit der Technologie sicherzustellen. Das folgende Framework kann Unternehmen bei der Entwicklung und Anwendung von verantwortungsvoller generativer KI unterstützen.

1. Human-centricity: Mensch stets im Fokus

Das menschliche Wohlergehen muss bei jeder Art von KI-Entwicklung im Vordergrund stehen. Im Vorfeld der Einführung eines neuen Tools ist daher unter anderem zu beantworten, inwieweit das Projekt mit den ethischen Prinzipien der Organisation im Einklang steht, ob der Use Case positive Ziele für die Gesellschaft verfolgt, wem eventuell Schaden entstehen könnte oder welche Auswirkungen langfristig zu erwarten sind.

2. Transparency: Gründe für die Entwicklung

Um die Akzeptanz für neue Tools zu fördern, ist es unbedingt erforderlich, die Hintergründe der Einführung zu erklären. Entscheidend ist, ob die Resultate aus generativer KI-Anwendungen für Mitarbeiter verständlich und erklärbar sind, welche rechtlichen, finanziellen und Image-Risiken mit dem Einsatz verbunden sind, inwieweit mit generativer KI erstellter Content als solcher zu kennzeichnen ist, und welche Art von Tests Prüfstandards erfordern.

3. Robustness: Bewusstsein für Beschränkungen und Risiken

KI-Tools sind in der Regel für einen bestimmt Zweck erstellt, werden sie darüber hinaus genutzt, kann Schaden entstehen. Um dies zu vermeiden, gilt es, Fragen zu beantworten wie:

- Ist die generative KI ausreichend mit Daten trainiert worden, die zum spezifischen Use Case passen?

- Geschieht der Einsatz innerhalb des vom Entwickler vorgegebenen Rahmen?

- Lassen sich die Ergebnisse, die die Anwendung hervorbringt, zuverlässig reproduzieren?

- Unter welchen Umständen könnte die Anwendung fehlschlagen, und wie ist darauf zu reagieren?

4. Privacy and Security: Sicheres Umfeld schaffen

Anwender und Unternehmen wähnen sich bei ChatGPT und Co. unter Umständen in einem datengesicherten Umfeld – und geben dabei unwissentlich vertrauliche Informationen preis. Zu hinterfragen ist, ob ein Risiko besteht, persönliche beziehungsweise sensible Informationen oder intellektuelles Eigentum zu teilen. Welche rechtlichen Vorgaben und Richtlinien sind zu beachten? Welchen Cyberattacken oder sonstigen Angriffen ist die Anwendung ausgesetzt?

„Damit generative KI einen maximalen Mehrwert generiert, müssen moderne KI-Technologie, durchgängige Governance und entsprechend geschulte Anwender zusammengehen – und das unter kontinuierlicher kritischer Hinterfragung der zugrunde liegenden KI-Modelle sowie deren Anpassung.“

Sascha Schubert, SAS

5. Inclusivity: Diverse Anforderungen berücksichtigen

Um eine potenzielle Voreingenommenheit (Bias) der generativen KI-Modelle weitestgehend zu vermeiden, ist es wichtig, verschiedene Ansprüche an Diversität und entsprechende Perspektiven immer mitzudenken. Zu beobachten ist daher, ob die Anwendung unterschiedliche Ergebnisse für einzelne Personengruppen liefert, und aus welchen Gründen die Ergebnisse für Personen mit ähnlichen Charakteristika abweichen. Oder zu hinterfragen, wie die Trainingsdaten die Inklusivität von generativen KI-Anwendungen beeinflussen können.

6. Accountability: Feedback an erste Stelle setzen

Unternehmen, die generative KI einsetzen, sind auch verantwortlich dafür, mögliche negative Auswirkungen von Entscheidungen, die sich auf Empfehlungen der Anwendung stützen, zu erkennen und einzudämmen. In diesem Kontext ist es wichtig zu klären, wie Ergebnisse beobachtet und gegebenenfalls korrigiert werden, wie die Organisation sicherstellen kann, dass das Tool keine Fehlinformationen verbreitet oder negative Themen bestärkt, ob der Use Case genügend vertraut ist, damit Anwender Fehler erkennen, welche Feedbackmechanismen vorhanden sind, um die Technologie zu verbessern.

Erfolgsrezept im Business: Technologie + Governance + Know-how

Generative KI ist weitaus vielseitiger als ChatGPT und andere Anwendungen, die Verbrauchern bekannt sind. Handfeste Vorteile verschafft die Technologie Unternehmen jedoch nur dann, wenn sie unter Berücksichtigung der genannten Prämissen eingesetzt wird. Damit generative KI maximalen Mehrwert generiert, müssen moderne KI-Technologie, durchgängige Governance und entsprechend geschulte Anwender zusammengehen – und das unter kontinuierlicher kritischer Hinterfragung der zugrunde liegenden KI-Modelle sowie deren Anpassung.

Über den Autor:

Sascha Schubert führt das EMEA Cloud, Data and AI Team in der Global Technology Practice bei SAS. Der Fokus seiner Tätigkeit liegt darauf, Innovationen im Bereich Analytics und künstliche Intelligenz in Strategien für die Optimierung von Geschäftsprozessen zu übertragen. Schubert hat in seinen mehr als 25 Jahren bei SAS zahlreiche Projekte umgesetzt, die Unternehmen mit Machine Learning und KI geholfen haben, effektiver und wettbewerbsfähiger zu werden.

Die Autoren sind für den Inhalt und die Richtigkeit ihrer Beiträge selbst verantwortlich. Die dargelegten Meinungen geben die Ansichten der Autoren wieder.