luchschen_shutter - Fotolia

Mit PCIe 5.0 und NVMe 2.0 die Storage-Leistung steigern

Der Markterfolg von PCIe 5.0 hängt davon ab, dass damit ausgerüstete Server auf den Markt kommen. Ein Massenmarkt für PCIe 5.0 entsteht vielleicht erst 2025/26.

Viele leistungshungrige IT-Einkäufer aus Unternehmen wenden sich bereits an IT-Hersteller, um zu erfahren, ob und wann sie PCIe 5.0 und NVMe 2.0 unterstützen.

Die Herstellerorganisation NVMe Express Inc. hat Version 2 der NVMe-Spezifikation inzwischen fertiggestellt. Sie verringert die Latenz und erhöht die Storage-Leistung. Zu den neuen Funktionen von NVMe 2.0 gehören Funktionen und Befehle für Key-Value (KV) und Zoned Namespace (ZNS). Sie laufen auf PCIe, Remote Direct Memory Access (RDMA) und der TCP-Transportschicht.

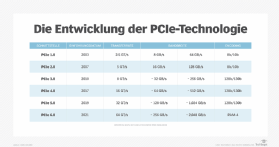

Von PCIe 4.0 auf PCIe 5.0 zu aktualisieren, verdoppelt die Datenrate von 16 Gigatransfers pro Sekunde auf 32 GT/s. Die aggregierte Bandbreite steigt von nahezu 64 GB/s auf 128 GB/s auf einer Verbindung mit 16 Kanälen. Der zusätzliche Durchsatz kann besonders bei rechenintensiven Workloads wie KI und ML nützlich sein.

Produkte kommen ab 2022

Unternehmen werden wohl noch eine Weile auf neue Produkte warten müssen, die diese Technologie unterstützen. So werden Kundenmuster der ersten PCIe-5.0-SSD von Marvell Technology erst seit 2021 hergestellt. PCI-SIG (PCI Special Interest Group) gab PCIe 5.0 2019 frei, also zwei Jahre früher. Marvell, ein Unternehmen mit Hauptsitz in Wilmington, Delaware, rechnet nicht mit großen Volumina für seine PCIe-5.0-Bravera-SC5-Controller bis auch mit PCIe-5.0 ausgerüstete Server in großer Anzahl produziert werden. Das werde für die zweite Jahreshälfte 2022 und 2023 prognostiziert, sagt ein Unternehmenssprecher.

Intel gab im Juni bekannt, dass die nächste Generation des Xeon Scalable mit dem Codenamen Sapphire Rapids und PCIe 5.0-Ausrüstung im ersten Quartal 2022 Produktionsstückzahlen erreichen wird. Mit größeren Volumina rechnet der Hersteller ab dem zweiten Quartal 2022. AMD hat noch keine Details zu seinen PCIe-5.0-Plänen bekanntgegeben.

Ganz anders verlief vor einigen Jahren die Markteinführung von PCIe 4.0: Nachdem der Standard 2017 fertiggestellt wurde, konnte AMD 2019 durch den PCIe-4.0-Support bei den Ryzen-Desktop- und Epyc-Serverprozessoren gewaltig aufholen. Intel dagegen liefert erst seit 2021 Prozessoren, die PCIe 4.0 unterstützen.

Tom Coughlin, Präsident von Coughlin Associates, einem auf Storage fokussierten Beratungsunternehmen, glaubt, dass obwohl die ersten PCIe-5.0-Produkte 2022 oder 2023 auf den Markt kommen werden. So könnte erst 2025/26 ein Massenmarkt entstehen. Mit NVMe 2.0-Produkten rechnet er gegen Ende des Jahres oder eher 2022.

Jim Hardy, Halbleiter-Analyst und Generaldirektor von Objective Analysis, sieht für NVMe 2.0 eine andere Entwicklung als die normale evolutionäre Marktdurchdringung. Das liege an der hinzugefügten Unterstützung für ZNS und Key-Value-Store. Allerdings glaubt er, dass NVMe-2.0-basierte SSDs Änderungen an Anwendungen erzwingen, damit die beiden Zusatzfunktionen unterstützt werden und Anwender tatsächlich von diesen Neuerungen profitieren.

Veränderungen an NVMe

Positiv ist an der Technologie, dass durch sie mehrere Technologien in einem Gerät vereinigt werden können: ein Namensraum für den Zugriff über ZNS, ein zweiter für Key-Value (KV) und ein dritter für NVMe-basierten Blockzugriff. Das sagen Vertreter des Konsortiums NVMe Express Inc. das die Weiterentwicklung der NVMe-Technologie definiert und managt.

Im Release 2.0 teilte NVM Express die Spezifikation in mehrere Bereiche auf: die NVMe-Basisspezifikation, Befehlssatzspezifikationen und Transportspezifikationen. Das solle es erleichtern, neue Befehlssätze und Transportschichten zu entwickeln, ohne bereits entwickelte zu beeinflussen, erklären NVMe-Sprecher.

Die vielfältigen Transportspezifikationen ermöglichen Geräten, sich auf diverse Weise mit dem Host-Server zu verbinden. Beispielsweise könnte eine NVMe-over-Fabrics-SSDs den NVMe-Befehlssatz und einen TCP-Transport nutzen. Eine NVMe-SSD könnte die NVM-Befehle und einen PCIe-Transport verwenden, und eine weitere SSD könnte die Befehlssätze für ZNS und KV für unterschiedliche Namensräume über PCIe bereitstellen.

Potentielle Vorteile von ZNS

Western Digital und Microsoft sind die ersten, die ZNS in NVMe Express integrieren. Der ZNS-Befehlssatz zielt auf Anwendungen, die sequentiell schreiben. Das Host-Betriebssystem schreibt die Daten auf unabhängige Zonen einer SSD.

Zu den wichtigsten Vorteilen dieses Vorgehens gehört, dass Over-Provisioning reduziert und damit größere Kapazitäten ermöglicht. Zudem ist weniger Garbage Collection nötig, so dass sich die Leistung besser prognostizieren lässt. Der dritte Vorteil bestehe darin, dass möglicherweise weniger DRAM und stromlose Schutzkondensatoren benötigt werden, was die Kosten senken würde, meint Dave Landsman, Vorstandsmitglied von NVM Express und Direktor Industriestandards bei Western Digital.

ZNS SSDs von Western Digital und Seagate sind schon in der Pipeline. Aber Eric Pike, Senior Director Cloud Enterprise Flash Marketing bei Western Digital, meint, bei ZNS werde es zu einer „langwierigen fortlaufenden Implementierung“ kommen. ZNS werde in dem Umfang implementiert, in dem die Hersteller die Entwicklung ihrer Software-Stacks an ZNS-Laufwerke anpassen.

„Diese beiden Teile müssen zusammenkommen, um die potentiellen Fähigkeiten der Technologie zu realisieren“, betont Pike. Er merkt an, dass es bei ZNS vor allem um effiziente Datenhandhabung gehe sowie um strukturierte Datensets für Transaktions-Workloads. Im Gegensatz dazu fokussiere KV auf die Speicherung unstrukturierter Daten.

Potentielle Vorteile von Key-Value

Samsung und NetApp haben die KV-Erweiterung in NVM Express eingebracht. Einer der wesentlichen Vorteile der Technologie ist der schnellere Datenabruf. Er basiert auf einer Gruppe von Schlüsseln, um die Daten zu identifizieren.

Vor KV verwendeten Objekte eine Host-basierte Übersetzungsschicht, um sich mit der Objektkennung, dem Schlüssel, mit einem oder mehreren logischen Datenblocks zu verbinden. Das Storage-System brauchte eine zweite Übersetzung, um von den logischen Blocks zu den physischen Speicherorten auf dem Storage-Medium zu gelangen. Das KV-Protokoll mache diese Übersetzungsschichten obsolet, erhöhe damit die Leistung und verringere den Storage-Bedarf, weil die Übersetzungstabellen wegfielen, bemerkt Bill Martin. Er repräsentiert Samsung in diversen Standardisierungsgremien für SSD/IO und gehört zum Vorstand von NVMe Express.

Laut Martin eignet sich KV am besten für Datenbankanwendungen wie RocksDB und Ceph. Die Technologie ermöglicht das Sharding von Storage-Objekten, die auf das KV-System geschrieben und von dort gelesen werden, ohne dass Übersetzungen im Host anfallen. Sharding ist eine Form der horizontalen Partitionierung, bei der größere Datenbanken in kleinere Stücke aufgeteilt werden, um sie besser handhaben zu können.

Eine weitere neue Schlüsselfunktion im Rahmen von NVMe 2.0 ist die Unterstützung von Festplatten, die dieselben Befehlssätze wie NVMe-basierte SSDs in einem konsolidierten I/O-Stack verwenden. Die Spezifikation fügt ein Bit hinzu, damit das Gerät als rotierendes Medium identifiziert werden kann, unterstützt Gerätestatistik und Log-Seiten mit HDD-spezifischen Informationen. Der Host-Server und die Host-Applikationen können das optimale Medium für spezifische Applikationen bestimmen, erklärt der NVM-Express-Vorstand.

„Ein einziger Satz von Storage-Schnittstellen vereinfacht die Systemintegration und das Management“, sagt Coughlin.

Hardy allerdings sieht wenige Gründe für HDDs, PCIe einzusetzen. Denn die Technologie beschränke die Möglichkeiten von rotierenden Festplatten, sich mit dem Computer zu verbinden. Die bestehenden HDD-Schnittstellen unterstützten bereits die höchsten Leistungen, die eine Festplatte bringen kann, meint er.

Wann oder ob NVMe-basierte HDDs verfügbar sein werden, bleibt eine offene Frage. Toshiba beispielsweise hat laut Raghu Gururangan, Vice President Engineering und strategische Planung, keine offiziellen Pläne hinsichtlich NVMe-HDDs auf seiner Roadmap. Allerdings, so fügt er hinzu, nehme das Unternehmen weiter am Standardisierungsprozess teil und beobachte genau, wie der Markt NVMe-HDDs annimmt.

Weitere NVMe-2.0-Eigenschaften

Weitere Verbesserungen, die NVMe 2.0 bietet, sind laut NVM Express:

- Gruppen-Management von Platten gleicher Lebensdauer (Endurance Group Management). Die Funktion ermöglicht den Aufbau von NVMe-Storage-Domains innerhalb von SSDs oder über mehrere SSDs hinweg, die auf einer ähnlichen Lebensdauer und QoS-Charakteristiken (Quality of Service) beruhen. Attraktiv ist das für Hyperscale-Rechenzentren, die dann Domänen für spezifische Applikationen aufbauen können.

- Einfacher Kopierbefehl (Simple Copy Command). Damit lassen sich mehrere logische Blocks in einen größeren, zusammenhängenden Block kopieren und so die Schreibverstärkung verringern. Das erhöht die Lebensdauer des Laufwerks.

- Befehlsgruppen-Kontrolle (Command Group Control): Schützt SSDs nach der Bereitstellung und verhindert unautorisierte Zugriffe auf das Laufwerk.

- Neue Schlüssel für jeden Ein-/Ausgabevorgang (I/Os): Anwendungen können einen Sicherheitsschlüssel für jede von ihnen vollzogene I/O vergeben.

- Mehrere Namensräume parallel: NVM, KV und ZNS-Befehlssätze laufen in unterschiedlichen Namensräumen, die sich potentiell auf demselben Laufwerk befinden. So können unterschiedliche Workloads dieselbe NVMe-SSD verwenden.