vchalup - stock.adobe.com

Regulação da IA: o que as empresas precisam saber em 2023

A rápida evolução e adoção de ferramentas de IA fez com que os legisladores lutassem para aplicar leis de IA eficazes. O professor de direito Michael Bennett discute o que acontece em 2023.

A ideia de inteligência artificial, ou mentes sintéticas capazes de pensar e raciocinar de forma que se aproximem das capacidades humanas, tem sido tema de debate durante séculos. Muitas culturas antigas expressaram ideias e até perseguiram esses objetivos. No início do século 20, a ficção científica começou a cristalizar a noção para grandes audiências modernas. Histórias como O Mágico de Oz e filmes como Metrópolis comoveram o público em todo o mundo.

Em 1956, John McCarthy e Marvin Minsky organizaram o Dartmouth Summer Research Project on Artificial Intelligence, durante o qual o termo inteligência artificial (IA) foi cunhado e introduzido, e a corrida por maneiras práticas de realizar o antigo sonho começou a sério. Nas cinco décadas seguintes, o desenvolvimento e o entusiasmo pela IA aumentaram e diminuíram, mas à medida que o poder computacional que impulsionou a era digital cresceu exponencialmente enquanto os custos de computação caíram vertiginosamente, a IA definitivamente saiu do reino da especulação, da ficção científica para a realidade tecnológica. No início dos anos 2000, os investidores investiram grandes quantias de fundos para acelerar e aprofundar os recursos dos sistemas de IA.

Avanços tecnológicos recentes destacam a importância da regulamentação da IA

Em 2023, sistemas generativos de inteligência artificial –ferramentas capazes de produzir conteúdo novo e original, como imagens, texto ou áudio– são onipresentes no discurso público. As empresas estão se esforçando para entender, adotar e implementar efetivamente o ChatGPT-4 e outros grandes modelos e algoritmos de linguagem. Os benefícios potenciais para empresas de todos os tamanhos estão em foco: maior eficiência nos processos, redução de erros humanos, custos reduzidos por meio da automação e descoberta de insights desconhecidos e imprevistos nas pilhas massivas e crescentes de dados proprietários e de domínio público.

Sem surpresa, os governos estão focados na regulamentação da IA. Preocupações perenes, como proteção ao consumidor, liberdades civis e práticas comerciais justas, explicam em parte o interesse dos governos de todo o mundo na IA.

Mas pelo menos tão importante quanto proteger os cidadãos contra as desvantagens da IA é a competição entre os governos pela supremacia na IA. Atrair cérebros e empresas significa necessariamente criar ambientes regulatórios previsíveis e navegáveis nos quais as empresas de IA possam prosperar.

Com efeito, os governos estão enfrentando Cila e Caríbdis reguladores de IA: por um lado, buscando proteger os cidadãos das desvantagens muito reais da implementação de IA em escala e, por outro, precisam projetar regimes de governança para uma IA complexa e em rápida mudança onda de choque que está permeando a sociedade.

Carreira mundial para regular los sistemas de IA

Em meio à rápida evolução e adoção de ferramentas de IA, os regulamentos e propostas regulatórias de IA estão se espalhando quase tão rapidamente quanto os aplicativos de IA.

Estados Unidos

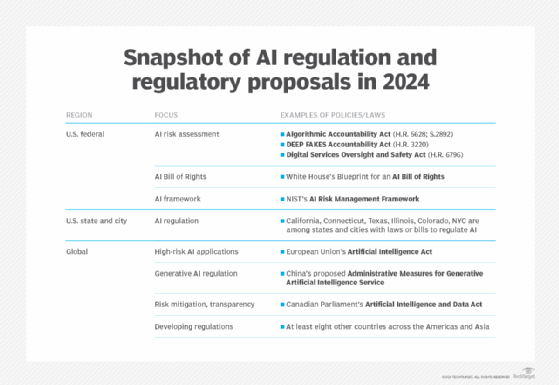

Nos EUA, o governo em praticamente todos os níveis está trabalhando ativamente para implementar novas proteções regulatórias e estruturas e políticas relacionadas, projetadas para cultivar simultaneamente o desenvolvimento da IA e reduzir os danos sociais possibilitados pela IA.

Regulamento federal. A avaliação de risco de IA é atualmente uma das principais prioridades do governo federal. Os legisladores dos EUA são particularmente sensíveis às dificuldades de entender como os algoritmos são criados e como eles chegam a determinados resultados. Os chamados sistemas de caixa preta dificultam a mitigação de riscos ou o mapeamento de processos e permitem a documentação de seus efeitos sobre os cidadãos.

Para resolver essas questões, a Lei de Responsabilidade Algorítmica (H.R. 6580; S.3572) está atualmente sendo debatida no Congresso. Se se tornar lei, exigiria que as entidades que usam sistemas de IA generativa em decisões críticas relacionadas a habitação, saúde, educação, emprego, planejamento familiar e áreas pessoais da vida determinassem os impactos nos cidadãos antes e depois do uso dos algoritmos.

Da mesma forma, o DEEP FAKES Accountability Act (H.R. 2395) e o Digital Services Oversight and Safety Act (H.R. 6796), caso passem pelo Congresso e se tornem leis aplicadas, exigiriam que as entidades fossem transparentes sobre a criação e divulgação pública de "falsos personificação[s]" e desinformação/desinformação criada por IA generativa, respectivamente.

E embora não seja uma lei, o Projeto da Casa Branca para uma Declaração de Direitos da IA é uma fonte formidável de governança federal no espaço da IA. O Blueprint compreende um conjunto de cinco princípios –sistemas seguros e eficazes; proteções de discriminação algorítmica; dados privados; aviso e explicação; e alternativas, considerações e alternativas humanas– que devem ser adotadas voluntariamente pelas empresas e integradas ao próprio design de seus sistemas de IA.

Combinado com o AI Risk Management Framework promulgado pelo Instituto Nacional de Padrões e Tecnologia, o governo federal dos EUA criou efetivamente um poderoso conjunto de políticas destinadas a proteger os americanos. Dado que essa orientação representa o maior empregador nos EUA e molda as ações da maioria das unidades do governo federal e da maior parte de seus funcionários, ao mesmo tempo em que exerce pressão sobre as entidades privadas para que cumpram sua agenda política de IA, essas políticas "voluntárias" propostas e princípios não devem ser subestimados.

Regulamentação estadual e municipal dos EUA. Os estados também estão entrando na corrida para regulamentar a IA. Califórnia, Connecticut, Texas e Illinois estão tentando atingir o mesmo equilíbrio que o governo federal: encorajar a inovação e proteger os constituintes das desvantagens da IA. Indiscutivelmente, o Colorado foi mais longe com seu Regulamento de Governança de Algoritmo e Modelo Preditivo, que imporia requisitos não triviais sobre o uso de algoritmos de IA por seguradoras de vida licenciadas do Colorado.

Da mesma forma, os municípios estão avançando com suas próprias portarias de IA. A cidade de Nova York está liderando o caminho com a Lei Local 144, que se concentra em ferramentas automatizadas de decisão de emprego –ou seja, IA usada no contexto de atividades de recursos humanos. Outras cidades dos EUA devem seguir o exemplo de Empire City em pouco tempo.

Global

Na Europa, a fonte dominante de governança de IA é a Lei de Inteligência Artificial da União Europeia. Como o AI Blueprint dos EUA, o principal objetivo do AI Act da UE é exigir que os desenvolvedores que criam ou trabalham com aplicativos de IA associados a alto risco testem seus sistemas, documentem seu uso e mitiguem os riscos tomando medidas de segurança apropriadas. Espera-se que a lei de IA da UE seja aprovada antes do final de 2023 e se aplique a todos os 27 países contidos nela. É importante ressaltar que a Lei de IA da UE provavelmente gerará um "Efeito Bruxelas" ou reverberações regulatórias significativas muito além dos limites da Europa.

A Administração do Ciberespaço da China está atualmente buscando comentários públicos sobre as medidas administrativas propostas para o Serviço de Inteligência Artificial Generativa que regularia uma série de serviços prestados aos residentes da China continental.

O Parlamento canadense está atualmente debatendo a Lei de Inteligência Artificial e Dados, uma proposta legislativa projetada para harmonizar as leis de IA em suas províncias e territórios, com foco particular na mitigação de riscos e transparência.

Nas Américas e na Ásia, pelo menos oito outros países estão em vários estágios de desenvolvimento de suas próprias abordagens regulatórias para governar a IA.

Impacto potencial da regulamentação da IA nas empresas em 2023

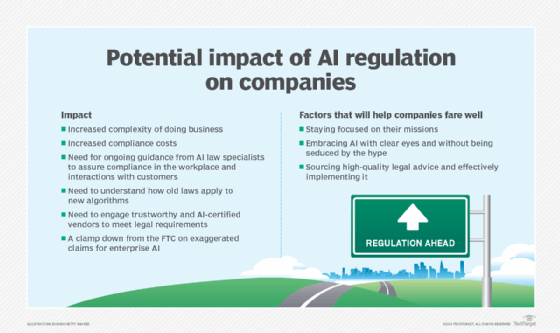

Para empresas localizadas, fazendo negócios ou procurando por talentos em uma ou mais das jurisdições mencionadas acima, a importância desse fermento regulatório é dupla.

Primeiro, as empresas devem prever uma taxa contínua e talvez acelerada de chegada de novas propostas regulatórias e leis aplicadas em todas as principais jurisdições e em todos os níveis de governo nos próximos 12 a 18 meses.

Esse aumento da atividade regulatória provavelmente levará a pelo menos dois resultados previsíveis: aumento da complexidade dos negócios e aumento dos custos de conformidade. Um verdadeiro emaranhado de regulamentação de IA exigirá novos conhecimentos e provavelmente atualizações regulares de especialistas em leis de IA, a fim de garantir a conformidade no local de trabalho, bem como a conformidade nos compromissos com clientes e consumidores.

Uma questão particularmente espinhosa provavelmente serão as possíveis interações entre as políticas de IA e os regulamentos preexistentes. Por exemplo, no contexto dos EUA, a Comissão Federal de Comércio sinalizou claramente sua intenção de reprimir reivindicações exageradas de IA corporativa. As empresas precisarão estar especialmente cientes das formas como as leis antigas se aplicam aos novos algoritmos, em vez de simplesmente focar nas novas leis que contêm "IA" em seus títulos.

Além disso, as empresas precisarão ser extremamente cuidadosas ao se envolver com novos fornecedores emergentes para facilitar os requisitos legais comuns para vários tipos de certificação de uso de IA. Encontrar fornecedores confiáveis, ou provavelmente certificadores certificados, será essencial não apenas para cumprir as novas leis, mas também para sinalizar aos consumidores que eles são tão seguros quanto possível e para satisfazer as seguradoras de negócios de que as empresas estão gerenciando com eficácia os riscos de IA.

O futuro imediato da regulamentação da IA quase certamente será uma estrada acidentada. As empresas que mantêm o foco em suas missões, adotam a IA com olhos claros e sem se deixarem seduzir pelo hype, ao mesmo tempo em que obtêm consultoria jurídica de alta qualidade e a implementam com eficácia, se sairão bem.

Sobre o autor: Michael Bennett é diretor de currículo educacional e líder de negócios para IA responsável no Instituto de Inteligência Artificial Experimental da Northeastern University em Boston. Anteriormente, ele atuou como diretor de programas de aprendizado de imersão experiencial do aluno do Discovery Partners Institute na Universidade de Illinois. Ele possui um JD da Harvard Law School.