Getty Images/iStockphoto

Estados no EUA agem enquanto o Congresso paralisa os regulamentos de IA

Os estados do país norte-americano estão avançando nas regulamentações de inteligência artificial enquanto o Congresso debate o melhor caminho a seguir.

Embora definir barreiras em torno da inteligência artificial (IA) seja algo com o qual o Congresso continua lutando, os estados estão elaborando padrões e regras para empresas que usam a tecnologia em rápida evolução.

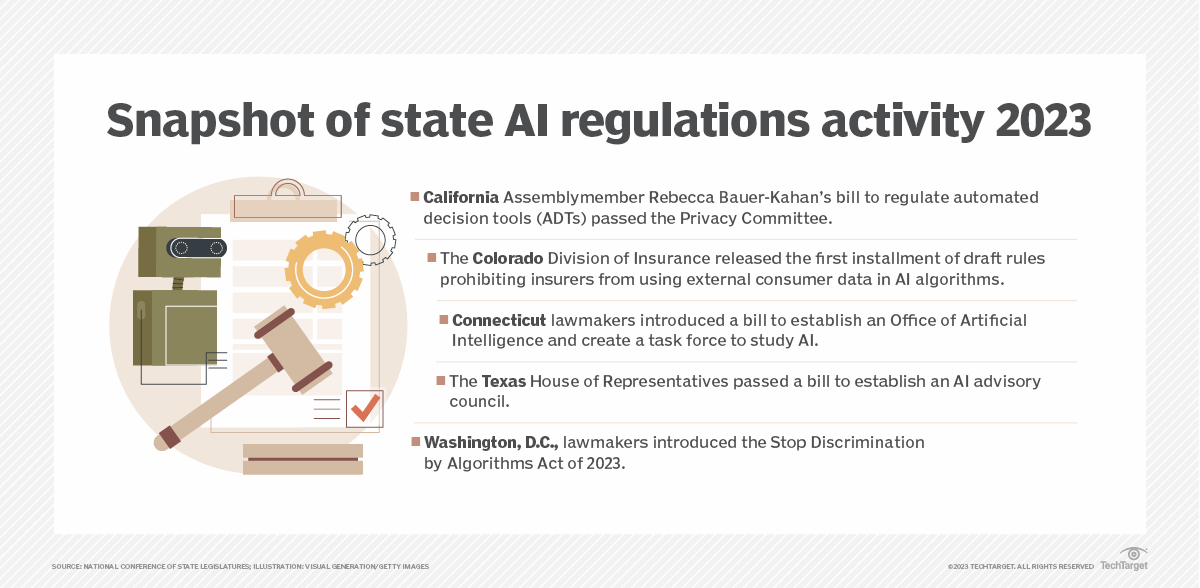

Vários estados, incluindo Califórnia, Illinois, Texas e Colorado, introduziram ou aprovaram leis focadas em proteger os consumidores dos danos causados pela IA. Embora empresas, seguradoras e agências governamentais usem a IA há anos em decisões de contratação, empréstimo e habitação, as preocupações com a tecnologia que tomam decisões tendenciosas e discriminatórias são crescentes.

Na verdade, a pesquisa mostrou que algoritmos e ferramentas automatizadas de tomada de decisão podem levar a decisões discriminatórias. Um estudo de 2020 publicado no Journal of General Internal Medicine mostrou que um algoritmo de IA diminuiu as oportunidades de encaminhamento de transplante para pacientes negros. Outro relatório da ProPublica em 2016 revelou que o software de inteligência artificial usado para conduzir avaliações de risco criminal em Broward County, Flórida, tinha maior probabilidade de identificar falsamente réus negros como propensos a cometer crimes futuros.

O Congresso ainda não aprovou nenhuma legislação para regular a IA e agora está enfrentando novos desafios com a tecnologia trazida pelo aumento da popularidade do ChatGPT da OpenAI. Os formuladores de políticas realizaram várias audiências este ano para entender melhor os riscos dessa tecnologia, que vão desde a violação de direitos autorais até a disseminação de desinformação gerada por IA.

Em um padrão semelhante ao modo como os estados agem em relação à privacidade de dados sem a orientação geral de uma lei federal de privacidade de dados, os estados estão abordando as questões de IA com suas próprias regras enquanto o Congresso está parado.

Estados agem

O Colorado está refinando regras para algoritmos preditivos usados por companhias de seguros que podem abrir caminho para a regulamentação futura do uso de IA em outros setores.

A Assembleia Geral do Colorado aprovou um projeto de lei em 2021 restringindo o uso de dados de consumidores de terceiros pelas seguradoras, como histórico educacional, pontuação de crédito e mídia social e hábitos de compras online, bem como algoritmos e modelos preditivos que usam esses dados e discriminam injustamente com base na raça, religião, sexo e outros fatores. A Divisão de Seguros do Colorado é responsável pela adoção de regras para tipos específicos de seguros e, em fevereiro, publicou a primeira parte dos regulamentos preliminares para seguradoras de vida. As normas preliminares especificam os requisitos da estrutura de governança e gerenciamento de riscos para modelos preditivos usados por agências de seguros.

O estado permitiu comentários públicos sobre o projeto de regras e agora as empresas estão aguardando a proposta final, disse Mary Jane Wilson-Bilik, sócia do escritório de advocacia Eversheds Sutherland. O estado também planeja publicar um rascunho de regra separado ainda este ano, que se concentra no teste de viés em sistemas de IA, o que Wilson-Bilik diz que será significativo.

Como testar os sistemas de IA quanto a viés e discriminação é algo que os reguladores além do Colorado estão lutando para descobrir –até mesmo os reguladores da União Europeia estão lutando para estabelecer padrões na lei de IA.

“Eles realmente são vistos como uma referência para a regulamentação dessa questão em todo o país”, disse ele sobre o Colorado. “Não só em seguros, mas também em outros setores.”

Enquanto isso, a deputada do estado da Califórnia, Rebecca Bauer-Kahan, apresentou um projeto de lei no início deste ano para regulamentar as ferramentas automatizadas de tomada de decisão. O projeto de lei exigiria que qualquer pessoa que usasse ferramentas automatizadas de tomada de decisão notificasse as pessoas sobre seu uso e proibiria ferramentas que causam discriminação algorítmica. Da mesma forma, os membros do conselho em Washington, DC, apresentaram um projeto de lei que exige que as empresas testem quaisquer algoritmos de IA em uso em busca de sinais de viés.

Quando o Congresso vai agir?

Wilson-Bilik disse acreditar que o Congresso reconhece os danos potenciais, conforme demonstrado pelo NIST AI Risk Management Framework e pelo Projeto da Casa Branca para uma Declaração de Direitos de IA. No entanto, ele disse que os reguladores estão tentando pensar sobre como regular e não esmagar a inovação.

"Existem muitas maneiras pelas quais os mesmos princípios são articulados", disse ele. "Agora é uma questão de colocar tudo isso em prática."

Juntamente com o lançamento da orientação de implementação da IA, várias agências de conformidade, incluindo a Federal Trade Commission, indicaram que as leis existentes de proteção ao consumidor se aplicarão às empresas que usam sistemas de IA até que novos regulamentos sejam propostos. O Departamento de Comércio dos EUA também publicou recentemente um pedido de informações sobre as medidas de responsabilidade da AI.

Na verdade, a regulamentação da IA se tornou um tema polêmico, disse Cameron Kerry, um líder global em IA e pesquisador visitante da Brookings Institution.

"Falando de modo geral, há muito interesse em maneiras de colocar algumas barreiras em termos de responsabilidade, transparência e fazer coisas como avaliações de risco, medição de desempenho e resultados", disse ele.

No entanto, Kerry disse que, embora as regras federais de IA sejam uma possibilidade, ele não está surpreso ao ver os estados agirem sobre o assunto nesse meio tempo e espera que os governos federal e estadual continuem a criar regras de IA.

"Acho que veremos os dois", disse ele. "Acredito em regulamentação nacional forte e consistente, mas há aspectos disso que historicamente têm sido regras estaduais. Emprego, seguro –eles foram regulamentados principalmente nos níveis estadual e local."

Makenzie Holland é redatora de notícias que cobre grandes regulamentações federais e de tecnologia. Antes de ingressar na TechTarget Editorial, ela foi repórter geral do Wilmington StarNews e repórter de crime e educação no Wabash Plain Dealer .